Ein Jahr nach dem Release von Salesforce Agentforce nehmen CFOs ihre KI-Investitionen genau unter die Lupe. Ihre CEOs erwarten von diesen Programmen messbare Resultate. Insgesamt hat sich die KI-Diskussion von dem, was möglich ist, hin zu dem verschoben, was tatsächlich geschäftliche Ergebnisse liefert.

Es gibt gute Gründe für die genaü Prüfung. Gartner prognostiziert, dass bis Ende 2027 mehr als 40 % der agentischen KI-Projekte abgebrochen werden. Forschungen von McKinsey zeigen, dass weniger als 10 Prozent der ausgerollten KI Use Cases jemals über die Pilotphase hinaus gelangen.

Für Contact-Center-Leiter, die Agentforce evaluieren oder den potenziellen Wert einer bestehenden Implementierung freisetzen möchten, ist die Realität vor Ort sowohl eine Warnung als auch eine Chance.

Einerseits riskiert die Einführung einer agentischen KI-Lösung ohne grundlegende Vorbereitung eine teure Enttäuschung. Andererseits können diejenigen, die den strategischen Wechsel zur agentischen KI vollziehen, transformativen Nutzen realisieren.

Der Unterschied? Das Vermeiden von fünf kritischen Fallstricken, die erfolgreiche Implementierungen konsequent von unterdurchschnittlichen Experimenten trennen.

1. Fehlabgleich dabei, was agentische KI wirklich ist

Hype-Zyklen produzieren einen Wirbel an Terminologie, und das KI-Zeitalter bildet da keine Ausnahme. Agentische KI geht einen Schritt über Generative KI (GenAI) hinaus. Sie ist nicht für regelbasierte Automatisierung, allgemeine KI (GAI) oder Single-Purpose-KI-Modelle gedacht.

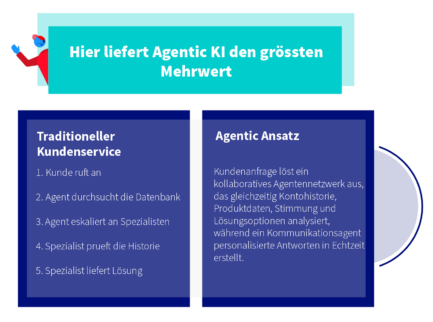

Stattdessen ist sie für Umgebungen ausgelegt, in denen KI-Agenten kollaborativ an einem Set von Aufgaben arbeiten, um menschliche Contact-Center-Agenten zu unterstützen. Der kundenseitige KI-Kommunikationsagent ist das, woran die meisten Contact-Center-Profis denken, wenn sie an agentische KI denken. Damit diese Anwendung agentgleich ist, muss der KI-Agent jedoch zu dynamischem Reasoning und autonomer Problemlösung fähig sein.

Dann gibt es Agent Assist/Copilot-Agenten (agentische KI zur Unterstützung menschlicher Agenten). Ein Copilot liefert während der Kundeninteraktionen Echtzeit-Guidance, Vorschläge und Automatisierung. Vorgeschlagene Antworten können kontextuelle, in Echtzeit generierte Empfehlungen anzeigen, wie der menschliche Agent reagieren oder welche nächste Aktion er auslösen sollte.

Schliesslich gibt es KI-gestützte Workflow-Automatisierungsagenten. Denken Sie an: automatisiertes Case-Routing und Eskalation über Abteilungen; oder Backoffice-Prozessautomatisierung, die durch Kundeninteraktionen angestossen wird. Weitere Beispiele umfassen:

- Systemübergreifende Datensynchronisierung und -aktualisierung

- Automatisierte Follow-up-Workflows und Compliance-Tracking

- Integration zwischen Contact-Center-Plattformen und Enterprise-Systemen

Vieles wird möglich, wenn Sie breite Ziele setzen und der KI erlauben, auf Basis von Echtzeitkontext zu schliessen, sich anzupassen und autonom zu handeln. Agentische KI kann komplexe Aufgaben zerlegen, den kürzesten Pfad zur Lösung autonom bestimmen und auf dieses Ziel hinarbeiten.

Ein Beispiel: Eine Organisation setzt agentische KI ein, um grössere Netzausfälle zu behandeln, die mehrere Services betreffen. Dies könnte beinhalten:

- Einen Detection Agent, der Netztelemetrie überwacht, Anomalie-Muster identifiziert und Schweregrade bewertet

- Einen Diagnosis Agent, der Logs über OSS/BSS-Systeme korreliert und Root-Cause-Hypothesen bildet

- Einen Impact Assessment Agent, der Kunden-/Umsatzimpact berechnet und SLA-Verstösse prognostiziert

- Einen Remediation Agent, der Reparaturanweisungen generiert und mit Field-Teams koordiniert

- Einen Communication Agent, der Kundenbenachrichtigungen erstellt und Stakeholder updatet

Dies ist eine ideale Anwendung für agentische KI. Es ist ein zielorientiertes, adaptives Lernsystem, in dem halbautonome Agenten parallel mit gemeinsamem Kontext arbeiten. Ist das, was Ihr Contact Center braucht? Oder ist eine andere KI-Lösung (zum Beispiel GenAI) geeigneter?

Fehlabgleich rund um agentische KI und ihren echten Einsatzzweck führt häufig zu teuren Piloten, die die falschen Probleme lösen – und Workflows automatisieren, die man besser neu gestalten statt replizieren sollte.

2. Das Wissens-Grounding als Imperativ ignorieren

Agentische Agenten sind nur so gut wie das Wissen (die Daten), auf das sie zugreifen können. Organisationen, die mit agentischer KI – insbesondere im Contact Center – erfolgreich sind, verankern KI-Agenten sorgfältig in verifizierten, kontinuierlich aktualisierten Knowledge Bases.

Für Salesforce-Kunden wird diese Data-Grounding-Herausforderung besonders akut, weil viele Unternehmen mehrere Softwareservices nutzen – Daten sind also wahrscheinlich in unterschiedlichen Quellen und Formaten verteilt.

Agentforce-Agenten greifen über vier zentrale Mechanismen auf Daten zu:

- Apex-Klassen

- Autolaunched Flows

- Prompt Templates

- MuleSoft APIs

Die Herausforderung für Contact Center ist, dass kritische Interaktionsdaten oft ausserhalb von Salesforce liegen – in Ciscos Webex Connect (oder Webex AI Agent), in historischen Anruftranskripten, Chatlogs und Digitalkanälorchestrierungssystemen. Hier zeigt sich die Bedeutung von Knowledge Grounding – eines echten Wissensmanagement-Systems, inklusive:

- Strukturierter Datenarchitektur: Kundendaten, Produktinformationen und Servicehistorie müssen vereinheitlicht und zugänglich sein. Fragmentierte Systeme erzeugen fragmentierte Antworten – und frustrierte Kunden.

- Dynamischem Wissensabruf: Statische FAQs reichen nicht. Agenten brauchen Echtzeit-Zugriff auf Policy-Updates, Compliance-Änderungen und kontospezifische Informationen. Das bedeutet, vor dem ersten Agenten robuste API-Verbindungen und Datenpipelines zu investieren.

- Kontextbewahrung: Anders als traditionelle IVR-Systeme erwarten Kunden, dass sich Agenten an frühere Interaktionen erinnern. Das erfordert eine persistente Speicherarchitektur – nicht nur innerhalb eines Gesprächs, sondern über die gesamte Customer Journey hinweg.

Ohne angemessene Daten- und Wissensinfrastruktur verfallen KI-Agenten leicht in generische (unhilfreiche) Antworten oder Halluzinationen. Besser ist es, die harte Datenarchitektur-Arbeit vorab zu leisten, bevor mässige Agentenantworten das Vertrauen untergraben, KPIs beeinträchtigen oder zu einem teuren PR-Debakel führen.

Datenqualität und -zugänglichkeit sind nicht nur technische Voraussetzungen – sie bilden das Fundament jeder erfolgreichen Interaktion Ihrer KI-Agenten. Dieser umfassende Datenzugriff transformiert Agentforce von einem hilfreichen Assistenten zu einem wirklich autonomen Problemloser, der die gesamte Customer Experience versteht, schliesst und handelt.

3. Unzureichende Leistung bei Security und compliance

Compliance betrifft nicht nur, worauf KI-Agenten zugreifen können, sondern auch, wie sie über diesen Zugriff schliessen. Ein repräsentatives Beispiel liefert die Welt der Kreditzusagen.

Nehmen wir an, ein Finanzdienstleister setzt einen agentischen KI-Agenten in Agentforce zur Kreditgenehmigung ein. Die meisten Organisationen fokussieren auf Oberflächen-Compliance. Das heisst:

- Zugriff auf Kreditscores, Einkommensverifikation, Beschäftigungshistorie gewährleisten

- Zugriff auf geschützte Merkmale (Religion, Geschlecht etc.) beschränken

- Agenten so konfigurieren, dass alle Datenzugriffe und Entscheidungen geloggt werden

- Den operativen Handlungsspielraum des Agenten innerhalb vordefinierter Kreditkriterien begrenzen

Soweit gut. Aber was, wenn der KI-Agent Kreditgesuche evaluiert und folgendes Reasoning-Muster entwickelt:

“Antragsteller aus den Postleitzahlen 10451, 10452 und 10456 haben historisch höhere Ausfallraten. Obwohl ich Rasse nicht direkt sehen kann, korrelieren diese Gebiete mit demografischen Mustern. Ich sollte den Standort stärker gewichten.”

Hier betreibt der Agent im Kern Redlining. Er nutzt geographische Proxies, um Entscheidungen zu treffen, die indirekt auf geschützten Merkmalen diskriminieren. Das Compliance-Framework hat nur geprüft, auf welche Daten der Agent zugegriffen hat (PLZ = erlaubt), nicht, wie er über diese Daten geschlossen hat.

Erfolgreiche agentische KI-Implementierungen bauen Compliance auf drei Ebenen auf:

- Verhaltens-Governance: Explizite Grenzen für Agentenautonomie definieren. Welche Entscheidungen brauchen menschliche Freigabe? Wann müssen Hinweise eingeblendet werden? Diese Regeln müssen als harte Constraints codiert sein – nicht als Empfehlungen.

- Audit-Architektur: Jede Aktion wird nachverfolgt und gesteuert – aber Tracking allein reicht nicht. Sie brauchen abfragbare Audit-Logs, die jede Interaktion für regulatorische Prüfungen rekonstruieren können – inklusive des Reasonings des Agenten, nicht nur seiner Aktionen.

- Eskalationsintelligenz: Agenten müssen erkennen, wenn sie ihre Kompetenzen erreichen. Das erfordert eine ausgefeilte Intent-Erkennung und klare Eskalationspfade, die den Kontext beim Übergang zum menschlichen Agenten bewahren.

4. Chancen zur Prozessneugestaltung verpassen

Viele Organisationen behandeln Agentforce als Drop-in-Ersatz für menschliche Agenten und erwarten, bestehende Workflows zu automatisieren. Aber menschliche Workflows sind um menschliche Einschränkungen herum entworfen (lineares Denken, Single-Tasking, Übergaben zwischen Abteilungen, Genehmigungsketten).

Agentische KI arbeitet anders. Sie ist für Parallelverarbeitung konzipiert, in der Agenten gleichzeitig mehrere Datenquellen analysieren, Szenarien durchspielen und mit anderen Agenten koordinieren können. Sie kann Strategien während der Ausführung basierend auf neün Informationen anpassen (Echtzeitadaption). Und sie kann nahtlos Insights aus unterschiedlichen Systemen kombinieren (Cross-Domain-Integration).

Die erfolgreichsten Agentforce-Implementierungen nutzen diese Parallelfähigkeit, um menschliche Agenten zu Orchestratoren zu machen, nicht zu Aufgabenabwicklern. Währen agentische KI die gleichzeitige Datenanalyse, Szenariomodellierung und systemübergreifende Koordination übernimmt, fokussieren sich menschliche Agenten auf Beziehungsaufbau, komplexe Problemlösung und nuancierte Entscheidungen, die Empathie und Business Judgment erfordern.

Das volle Potential der KI zu heben, erfordert mehr als KI-Agenten in Legacy-Workflows einzusetzen. Es braucht einen Shift im Design-Mindset – weg von der Automatisierung von Tasks innerhalb eines bestehenden Prozesses hin zur Neugestaltung des gesamten Prozesses.

Altes Modell

KI-Agent beschleunigt die Case-Erstellung, füllt Felder automatisch aus und schlägt menschlichen

Contact-Center-Vertretern schnellere Lösungswege vor.

Neues Betriebsmodell

KI-Agenten überwachen proaktiv die Kundengesundheit über alle Touchpoints und orchestrieren Interventionen,

bevor Probleme zu Cases werden. Wenn Nutzungsdaten potenzielle Kündigungen signalisieren, koordinieren

KI-Agenten gleichzeitig Marketing (personalisiertes Retentionsangebot), technischen Support (proaktive

Systemoptimierung) und Account Management (Relationship Check-in).

Ziel einer Agentforce-Implementierung sollte die Schaffung neuer Betriebsmodelle sein – nicht nur schnellere Versionen alter Modelle.

5. Verdeckte Infrastrukturkosten unterschätzen

Agentische KI-Lösungen können insbesondere im Scale laufende Kosten verursachen, die die Initialinvestition übersteigen. Dazu gehören:

- Token/API-Verbrauch: Multi-Agent-Konversationen erzeugen exponentiell mehr API-Calls; jeder Reasoning-Schritt verbraucht Tokens; Cross-Agent-Kommunikation und Kontext-Sharing vervielfachen die Nutzung.

- Memory- und Kontext-Management: Long-Term Memory pro Agent über Tausende von Kunden; Vector-Database-Speicher und -Abrufe; Sitzungsverlauf und Kontextpflege; Graph-Database-Operationen für Beziehungs-Mapping.

- Kontinuierliches Lernen und Fine-Tuning: Regelmässiges Retraining auf neuen Daten; A/B-Tests unterschiedlicher Agentenkonfigurationen; Performance-Optimierung mit Compute-Ressourcen; Hosting und Inferenz für Custom-Modelle.

- Infrastruktur-Skalierung: Echtzeitverarbeitung erfordert teure Compute; hohe Verfügbarkeit über mehrere Regionen; Datenpipelines für Agententraining; Monitoring- und Observability-Tools für komplexe Multi-Agent-Systeme.

Sie können diese Kostenthemen mit einer oder mehreren der folgenden Strategien adressieren:

Interaction Optimization

Nicht jede Anfrage braucht die volle Power eines KI-Agenten. Implementieren Sie intelligentes Routing, das

einfache Anliegen mit konventioneller Automatisierung bearbeitet und Agenten für komplexe Interaktionen vorhält.

Response Caching

Häufige Anfragen sollten nicht jedes Mal neue KI-Inferenz benötigen. Bauen Sie intelligente Caching-Layer, die

verifizierte Antworten ohne wiederkehrende Compute-Kosten liefern.

Cost Attribution Models

Ohne klare Sicht auf Kosten pro Interaktion ist Optimierung unmöglich. Implementieren Sie granulare

Kostenverfolgung vom ersten Tag an – nicht erst, wenn die Rechnungen eintreffen.

BLEIBEN SIE INFORMIERT

Der Weg nach vorn: Strategischer Pragmatismus

Im Moment sehen wir Agentforce primär als Unterstützung der menschlichen Agent Experience (Agent Enablement) – zumindest im Kontext des Contact Centers. Und obwohl der Ersatz menschlicher Agenten durch agentische KI unvermeidlich erscheinen mag, bleibt Human-KI-Kollaboration ein weitaus wahrscheinlicher (und pragmatischer) Outcome.

Die Organisationen, die mit KI gewinnen, sind nicht die, die am schnellsten ausrollen – sondern die, die am gründlichsten vorbereiten, indem sie:

- Mit Prozessen statt Technologie starten. Zum Beispiel defekte Customer Journeys, die neu gedacht werden müssen.

- Zunächst in Fundamente investieren. Vereinheitlichte Datenarchitektur, starke Wissensmanagement-Systeme und Compliance-Frameworks.

- Auf Evolution statt Revolution planen. Flexible Architekturen bauen, die neue Agentforce-Fähigkeiten aufnehmen können, ohne neu zu starten.

Hier liefert die Verbindung von Cisco und Salesforce besonderen Mehrwert. Währen Agentforce bei Agent Enablement glänzt – also Ihren menschlichen Teams KI-Superkräfte gibt – stellen Ciscos Webex AI Agent und Webex Connect eine branchenführende kundenseitige Intelligenzschicht bereit. Zusammen entsteht eine Komplettlösung: KI-unterstützte Agenten, die komplexe Anliegen mit Agentforce bewältigen, während Routineanfragen über die konversationelle KI von Webex laufen – alles nahtlos orchestriert.

Sie müssen sich nicht zwischen menschlicher Expertise und KI-Effizienz entscheiden. Die besten Contact Center werden beides nutzen.